-

Vous êtes ici :

- Accueil

- Publications

- Netsources

Les articles de Netsources

Quand l’IA redistribue les rôles

Il y a six mois, produire un tableau de bord de veille concurrentielle supposait un développeur, un cahier des charges, un délai. En 2026, une documentaliste d'un grand groupe industriel le fera seule, en deux heures, avec ChatGPT et/ou Lovable. Ce déplacement, de la demande IT à l'autonomie opérationnelle, n'est pas anecdotique. Il reconfigure les rôles, les postures et, progressivement, les organisations.

Ce numéro illustre ce basculement sous quatre angles complémentaires.

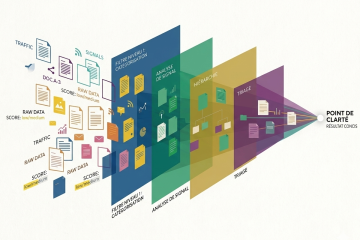

Véronique Mesguich analyse NewsCore, plateforme en IA native où agents, scoring de fiabilité et clustering reconfigurent la chaîne de veille. Son regard est nuancé : elle rappelle la robustesse des plateformes historiques sans les opposer à cette nouvelle génération. Le geste change : on ne requête plus un corpus, on programme des comportements. Le veilleur devient chef d'orchestre, ce qui suppose une maîtrise accrue de l'intention et de l'interprétation. L'expertise ne disparaît pas, elle se déplace vers ce que l'IA ne fait pas : définir le besoin, formuler l'intention, interpréter ce qui remonte.

NewsCore : un outil de veille emblématique du passage à l'IA native

Le passage à la veille "IA générative native" (ou GenAI-first) marque une transformation dans le monde des outils de veille. Contrairement aux solutions traditionnelles qui ont simplement « greffé » une couche d'IA ou des connecteurs, ces plateformes sont conçues dès l'origine autour de modèles de langage génératifs (LLM) capables de produire des synthèses, reformulations et analyses, et s'appuient sur le machine learning pour personnaliser et améliorer la pertinence. Il s'agit pourtant moins d'une nouvelle vague appelée à remplacer la précédente que d'une bascule du centre de gravité (interfaces conversationnelles, usages orientés production de contenus, nouvelles métriques), et d'une convergence entre nouveaux entrants et éditeurs historiques.

Examinons cette nouvelle génération à travers l'exemple de la plateforme NewsCore.

Que signifie IA native appliquée aux outils de veille ?

On parle d'IA native quand l'IA n'est pas juste une option (par exemple, un bouton ChatGPT pour résumer un article), mais le cœur du produit. Cela se traduit par plusieurs fonctionnalités liées aux étapes du processus de veille.

OpenAI lance son « App Store » et nous vibecodons un dashboard de veille

Fin 2025, OpenAI lance les Applications ChatGPT, un système permettant d'intégrer des services comme Tripadvisor, Canva ou Photoshop, utilisables directement dans la conversation. Nous décryptons cette évolution et la technologie sous-jacente qui rend cela possible, puis nous passons à la pratique en testant le vibe coding avec deux Applications ChatGPT.

En octobre 2025, OpenAI annonce l'ajout des Applications dans ChatGPT. Pour ceux d'entre vous qui suivent de près l'évolution de l'outil, l'impression de déjà-vu est inévitable : en janvier 2024, OpenAI lançait GPT Store, un catalogue de chatbots personnalisés créés par la communauté.

LIRE AUSSI :

Le context engineering : orchestrer l'information pour les agents IA, Netsources N° 179 - Novembre - Decembre 2025

Test complet de ChatGPT Agent : que vaut-il pour la veille, l'analyse concurrentielle et l'audit SEO ?, Netsources N° 177 - Juillet - Août 2025

Repenser la veille à l'ère des agents IA, Netsources N° 173 - Novembre-Décembre 2024

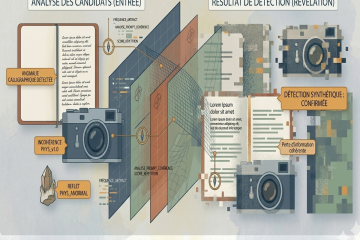

Images générées par l’IA : comment les repérer (et pourquoi c’est si compliqué)

Aujourd’hui, une photo de Donald Trump arrêté par la police peut faire le tour du monde avant que quelqu’un ne se rende compte… qu’elle n’a jamais existé. Les images générées par intelligence artificielle (IA) se multiplient sur les réseaux, parfois pour le divertissement, parfois pour désinformer. Mais une question persiste : comment savoir si une image a été créée par une IA ? Et surtout, pourquoi est-ce devenu si difficile ?

Les outils comme Midjourney, DALL·E ou Stable Diffusion ont démocratisé la création d’images bien avant le fameux Nanobanana de Google/Gemini, qui marque un tournant en combinant des capacités professionnelles à une vitesse de génération «Flash».

En quelques secondes, il suffit de taper une phrase comme “une femme en armure sous la pluie, style réaliste” pour obtenir une image bluffante et hyper réelle. Résultat : n’importe qui peut produire une photo “trop belle pour être vraie”. Et bien souvent, elle l’est. Si ces technologies sont fascinantes pour les artistes ou les créateurs de contenu, elles posent un vrai problème dans un monde où une image suffit à créer le doute : politique, désinformation, fake news… L’IA brouille les frontières entre le réel et le faux.

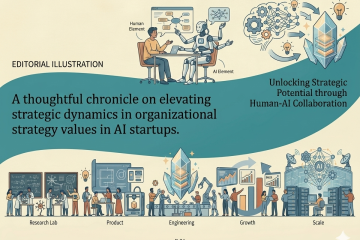

« Mon premier product manager sera ma 120ème recrue »

Christian Vigne (Narra), anciennement Product Manager chez Google, s’amuse dans ses chroniques à explorer l’impact de l’IA sur nos vies. Il est amené à conseiller les entreprises sur leurs stratégies IA (cadrage, priorisation, formation, conduite du changement).

C’est probablement l’idée la plus éclairante que j’ai tirée de très rares conversations que j'ai eues des dirigeants de startups d’IA de pointe. J’ai d’abord été un peu déstabilisé : d’un côté, la prise de conscience que c’est tout à fait logique ; et, de l’autre, qu’à terme cela pourrait générer des tensions.

Pour ce type de startup - ou plus largement pour les entreprises technologiques du même écosystème- cela a parfaitement du sens. La technologie ouvre la voie, car l’enjeu est de convaincre une communauté de développeurs d’adopter un modèle, d’attirer des chercheurs, d’inciter des investisseurs à s’engager, de se faire remarquer grâce à des avancées techniques, et de garder une longueur d’avance sur des concurrents ayant les mêmes objectifs.

Les Tags de Netsources

- IA

- brevets

- cartographie

- SEO

- open access

- livrables de veille

- humain

- médias sociaux

- sourcing veille

- flux RSS

- professionnel de l'information

- open data

- recherche vocale

- information business

- agrégateurs de presse

- à lire

- conférences salons

- information scientifique et technique

- outils de recherche

- outils de veille

- tendances

- multimédia

- actualités

- méthodologie

- serveur de bases de données

- curation

- due diligence

- recherche visuelle

- outils de traduction

- fake news

- fact checking

- publicité

- géolocalisation

- marques

- appels d'offres

- sommaire

- formation Veille Infodoc

- retour d'expérience

- OSINT

- propriété intellectuelle

- presse en ligne

- recherche Web

- évaluation outils

- références bibliographiques

- résumé automatique

- Bing

- veille collaborative

- veille audiovisuelle

- veille innovation

- infobésité

- études de marché

- données statistiques

- dataviz

- information financière

- LexisNexis

- Newsdesk

- sourcing pays

- veille medias

- veille commerciale

- réseaux sociaux

- newsletter

- veille à l'International

- ist

- ChatGPT

- veille métier

- intelligence économique

- veille concurrentielle

- podcast

- science ouverte

- open source

- veille technologique

- knowledge management

- édito

- Intelligence artificielle

- navigateur IA

- sécurité informatique

- navigateur agentique

- méthodologie et livrables

- Deepfakes

- plateforme de veille

- marketing